0 引言

1 研究数据与方法

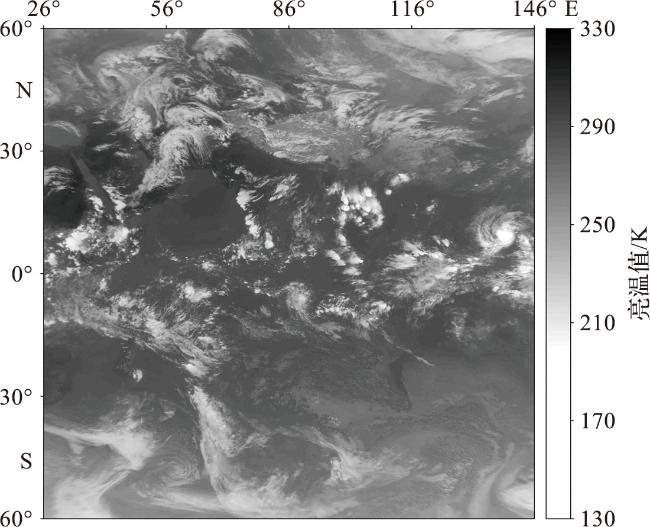

1.1 数据

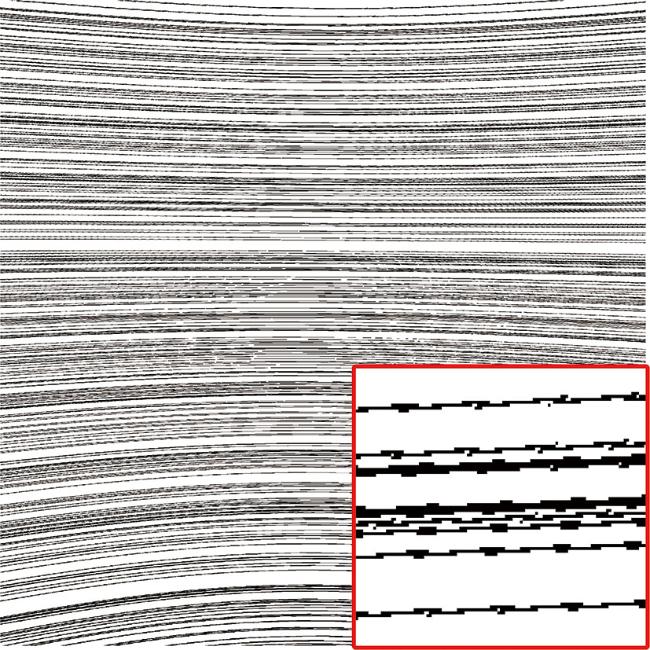

1.2 模型数据集的构建

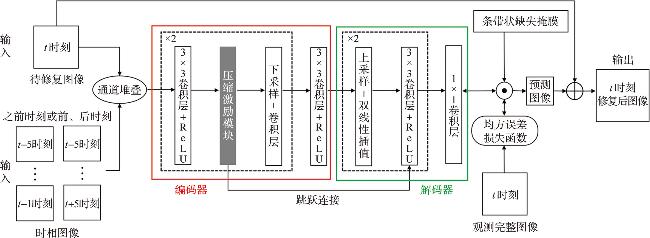

1.3 卷积神经网络模型

1.4 时相辅助数据筛选实验

1.5 修复效果评价

2 结果

2.1 不同多时相图像组合作为输入时模型的修复精度

表1 以不同的时相图像组合作为模型输入时的图像修复精度评价Tab.1 Evaluation of image reconstruction accuracy using different combinations of temporal inputs |

| 模型输入(时相图像组合) | MAE/K | PSNR/dB |

|---|---|---|

| 前1个时相 | 0.827 | 43.777 |

| 前2个时相 | 0.879 | 43.634 |

| 前3个时相 | 0.791 | 43.962 |

| 前4个时相 | 0.728 | 44.181 |

| 前5个时相 | 0.776 | 44.030 |

| 前、后各1个时相 | 0.871 | 43.728 |

| 前、后各2个时相 | 0.725 | 44.324 |

| 前、后各3个时相 | 0.695 | 44.470 |

| 前、后各4个时相 | 0.753 | 44.154 |

| 前、后各5个时相 | 0.795 | 44.023 |

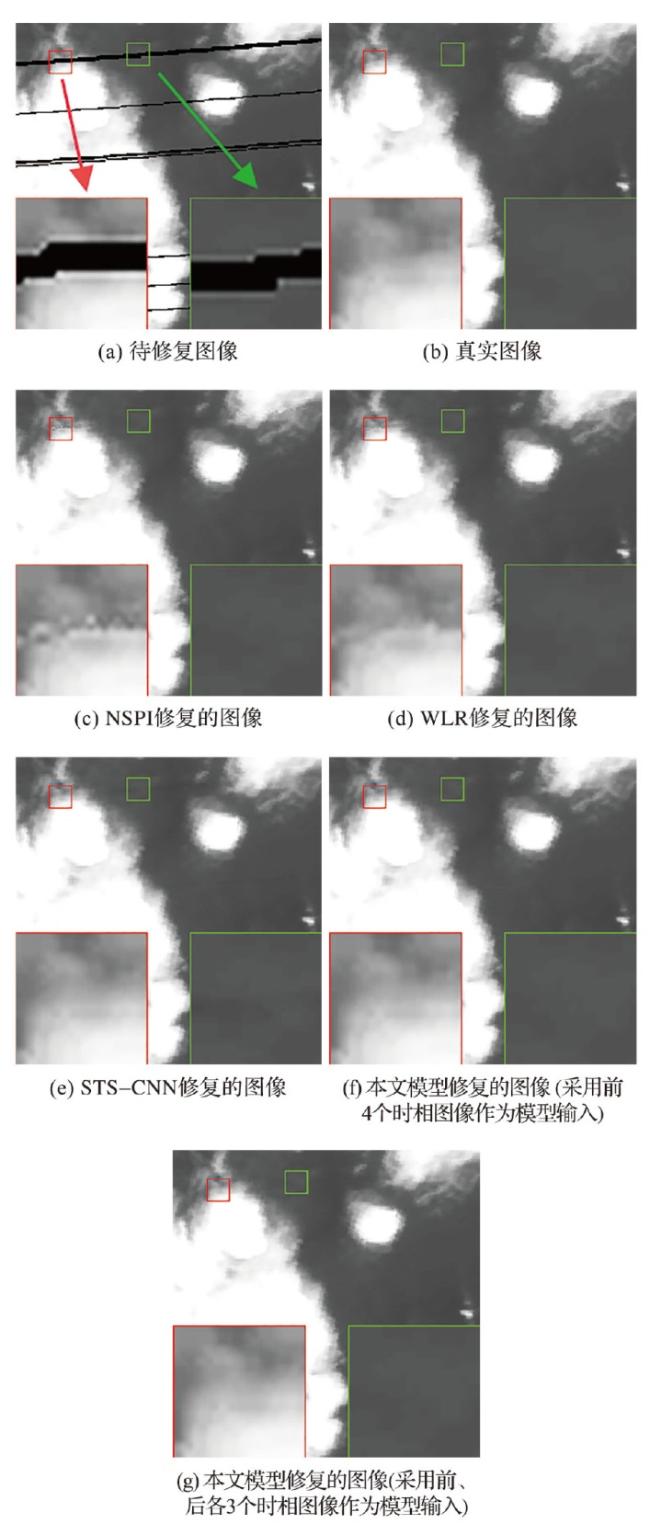

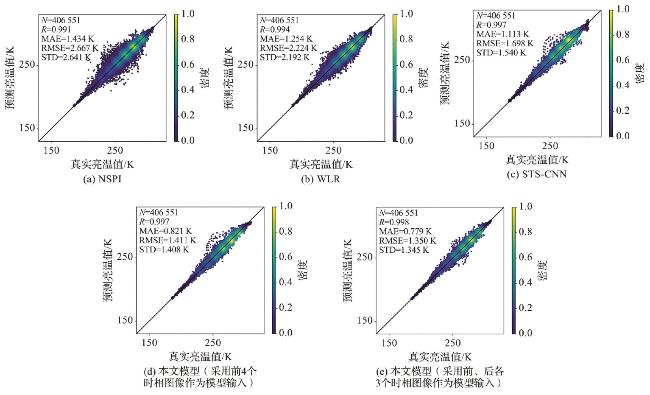

2.2 单/多时相图像为辅助的修复效果对比

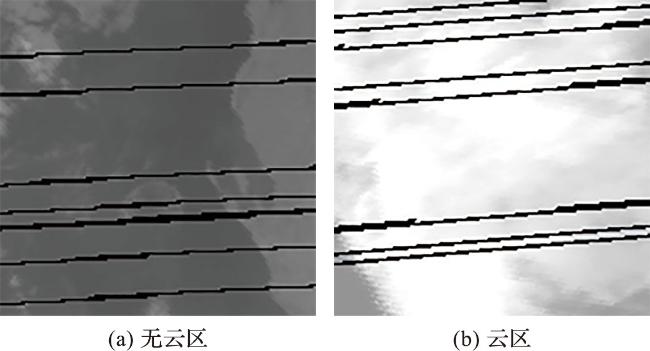

表2 不同模型的修复精度Tab.2 Reconstruction accuracy of different models |

| 模型 | 无云陆地区 | 无云海洋区 | 云区 | |||||

|---|---|---|---|---|---|---|---|---|

| MAE/K | PSNR/ dB | MAE/K | PSNR/dB | MAE/K | PSNR/dB | |||

| NSPI | 0.682 | 43.095 | 1.062 | 39.641 | 1.941 | 35.662 | ||

| WLR | 0.674 | 43.682 | 0.920 | 41.299 | 1.705 | 37.209 | ||

| STS-CNN | 0.698 | 44.475 | 0.831 | 43.974 | 1.490 | 39.413 | ||

| 本文模型(采用前4个时相图像作为模型输入) | 0.882 | 43.158 | 0.584 | 45.493 | 1.118 | 41.129 | ||

| 本文模型(采用前、后各3个时相图像作为模型输入) | 0.474 | 47.391 | 0.555 | 45.662 | 1.077 | 41.535 | ||

2.3 本文模型在其他静止卫星数据修复中的适应性

表3 本文模型对MTSAT数据修复的精度Tab.3 Reconstruction accuracy of the proposed model on MTSAT data |

| 模型输入 | 无云区 | 云区 | |||

|---|---|---|---|---|---|

| MAE/K | PSNR/dB | MAE/K | PSNR/dB | ||

| 前4个时相图像 | 0.427 | 48.579 | 0.880 | 42.437 | |

| 前、后各3个时相图像 | 0.416 | 48.645 | 0.877 | 42.761 | |